L’une des choses que je préfère dans l’utilisation du Vision Pro d’Apple, et qui lui confère un caractère futuriste unique, c’est qu’il n’a pas de manettes. Au lieu de cela, il suit mes mains. Ses commandes gestuelles de base, comme le pincement et le glissement, sont fantastiques.

Dans les espaces immersifs 3D plus complexes, le langage gestuel pratique semble s’effondrer. Apple a intégré son système de navigation 2D dans l’ensemble de Vision OS, mais les interactions 3D plus profondes ne sont pas encore tout à fait au point.

Les casques Quest de Meta, qui sont les concurrents les plus proches d’Apple, utilisent principalement des contrôleurs physiques mais disposent également d’un suivi des mains sans contrôleur, et parfois le suivi des mains de Meta semble meilleur que celui de Vision Pro pour les interactions 3D telles que la saisie d’objets dans l’espace. Les différences entre les casques et la façon dont nous utilisons le suivi des mains sont peut-être en train de changer. Les casques VR compatibles avec la réalité mixte et le suivi des mains n’en sont qu’à leurs débuts, et une conversation que j’ai eue avec l’un des plus grands développeurs de jeux VR m’a laissé entendre que les choses pourraient encore changer prochainement.

Les jeux comme porte d’entrée vers de nouvelles idées

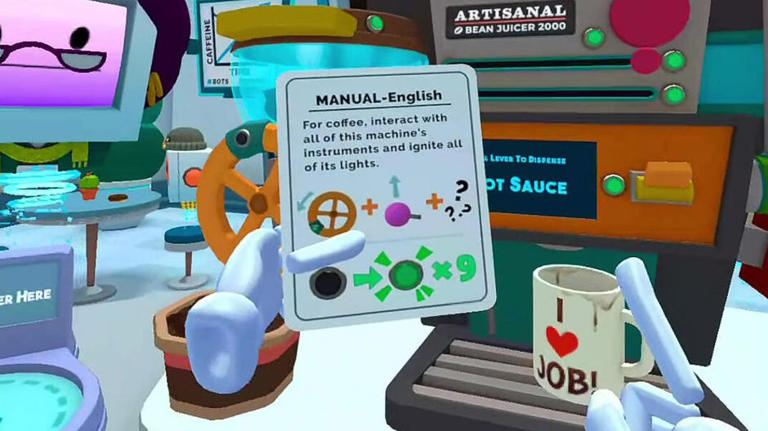

Owlchemy Labs, acquis par Google en 2017, a créé les jeux VR classiques Job Simulator et Vacation Simulator. Ces deux jeux sont destinés à la Vision Pro cette année, adaptés pour fonctionner entièrement avec le suivi des mains – aucun contrôleur n’est nécessaire.

Owlchemy explore le suivi des mains depuis un certain temps : Vacation Simulator en dispose déjà en mode expérimental sur Quest, et l’année dernière, j’ai essayé une démo qui expérimentait des interactions de suivi de la main plus avancées : utiliser des gestes basés sur le pincement pour déplacer des objets et presser des lettres pour taper sur des claviers virtuels, des mois avant qu’Apple ne présente ses premières démos de Vision Pro.

En 2024, à ce stade, les casques de réalité mixte donnent l’impression d’être divisés entre les modèles à suivi manuel uniquement et les modèles à contrôleur optionnel. Les casques Meta Quest et le Vision Pro d’Apple, par exemple, ont des interfaces très différentes. Ces différences pourraient commencer à s’estomper et évoluer plus loin que tout ce que nous avons vu jusqu’à présent.

Comme me l’a dit Andrew Eiche, PDG d’Owlchemy, lors d’une conversation récente, ces jours-ci ressemblent encore aux premiers jours des téléphones. Les téléphones ont fini par modifier considérablement leur langage gestuel multitouch au fil du temps.

Sommes-nous en train d’entrer dans la phase la plus profonde du suivi immersif de la main ?

« Ce qu’Apple a fait d’extraordinaire, c’est qu’elle a réussi à mettre au point l’interaction par pincement », explique M. Eiche. « Il s’avère que l’on peut construire tout un système d’exploitation à partir de cette interaction. Les démonstrations d’Owlchemy, qui font partie des premiers travaux sur un jeu avancé basé sur le suivi de la main sur lequel la société travaille, ont exploré certaines combinaisons d’interactions basées sur le regard et le pincement, mais aussi des contrôles plus profonds que la Vision Pro, à bien des égards, manque encore dans des expériences plus élaborées basées sur la 3D.

Eiche pense que ces interactions 3D sont, d’une certaine manière, plus faciles à ajouter ultérieurement. « D’une certaine manière, la 2D était l’un des problèmes les plus difficiles à résoudre. Les choses en 3D, non pas qu’elles ne soient pas plus difficiles, mais je pense qu’il est un peu plus facile, du point de vue de la cartographie cérébrale, de dire : si je ramasse une balle, je la ramasse. C’est plus facile à comprendre que le concept abstrait d’une barre de défilement ».

M. Eiche considère également que la phase actuelle de la réalité mixte basée sur les mains consiste à trouver ce qui fonctionne pour le moment, un peu comme les premiers pas des smartphones tactiles lors de l’apparition de l’iPhone. « Rappelez-vous, lorsque les smartphones ont fait leur apparition, la navigation sur le web était tout simplement terrible. Il fallait pincer, zoomer, pincer, zoomer, les liens étaient minuscules », explique M. Eiche.

Eiche considère la façon dont les gestes ont évolué comme la partie la plus intéressante. « Tirer pour rafraîchir : J’y pense tout le temps. C’est une interaction tellement géniale sur le téléphone. Mais elle n’aurait jamais vu le jour sur une autre plateforme. La RV n’a pas encore inventé le « pull to refresh » – nous en sommes encore loin.

Soulever la barre de répétition d’un réveil VR

Les jeux et applications individuels qui utilisent les interactions 3D sur Vision Pro sont pour l’instant très hétérogènes en ce qui concerne les styles d’interface. Certains utilisent le pincement et le glissement comme une souris, d’autres utilisent le suivi complet de la main et d’autres encore ont des idées intermédiaires, mais il n’y a pas beaucoup de cohérence.

Eiche considère que le suivi des mains est inévitable dans tous les casques et lunettes de réalité mixte, mais il souhaite que les concepteurs sortent de la « douleur 2D » et adoptent des interactions plus naturelles, comme la saisie d’objets. Son avis sur toutes les applications d’horloge spatiale sur Vision Pro, par exemple, est que vous devriez appuyer sur la barre de répétition avec votre propre main, et non pas regarder et pincer l’écran.

M. Eiche considère qu’il existe un autre point à prendre en compte, à savoir la manière dont plusieurs applications de réalité mixte cohabitent avec des interactions et des expériences qui ont un sens. Le Vision Pro permet à de nombreuses applications de cohabiter, alors comment les développeurs peuvent-ils rendre le fonctionnement multitâche plus intuitif ?

Le Vision Pro offre déjà une sorte de continuum entre la RV totalement immergée et la RA plus ouverte, en utilisant la couronne numérique pour activer ou désactiver la réalité, mais d’autres applications devront peut-être évoluer pour explorer différents niveaux d’engagement et d’immersion, à l’instar de ce qu’Eiche compare aux modes plein écran sur les ordinateurs portables.

Peut-être que les interfaces de suivi des mains changent également en fonction des niveaux d’immersion. Owlchemy n’a pas encore réalisé de jeux en réalité mixte, mais M. Eiche pense que cela impliquera des défis de conception différents : les applications doivent être prêtes à vivre avec des personnes qui peuvent être partiellement distraites en faisant ou en regardant quelque chose d’autre.

Qu’en est-il de l’haptique ou des contrôleurs ?

La Vision Pro, qui s’appuie entièrement sur le suivi de la main, se passe non seulement de contrôleurs, mais aussi de tout type de retour haptique vibrant, un élément que j’ai trouvé très important pour « sentir » les choses dans les expériences virtuelles. Eiche n’est pas aussi préoccupé par le manque d’haptique pour construire de très bonnes expériences de RV et de RA.

Le suivi des mains d’Owlchemy dans certaines interfaces 3D complexes dans des jeux comme Job Simulator, utilisant des boutons, des leviers et d’autres entrées tactiles, tire parti de certains mouvements de la main et de signaux audio intelligents. Pour M. Eiche, ils fonctionnent assez bien comme un type d’haptique virtuelle.

« Nos téléphones sont dotés de nombreuses fonctions haptiques, mais c’est parce que tout le monde est en mode silencieux », commente M. Eiche à propos des téléphones et des montres.

« Je ne pense pas que le mode silencieux s’appliquera aux casques d’écoute. M. Eiche estime que les indices visuels et sonores doivent être suffisamment convaincants pour donner l’impression d’être réels, comparant cela au fait d’imaginer boire un verre d’eau froide à l’aide d’une méthode de jeu. « Un son et une vue font beaucoup pour que le cerveau comprenne.

Un retour d’information ou une saisie plus avancés pourraient (et devraient) être fournis par des contrôleurs ou des dispositifs de saisie supplémentaires, comme les contrôleurs Touch de Meta, ou un Apple Pencil surpuissant, l’Apple Watch ou même un anneau (comme celui utilisé par le casque de réalité mixte de Sony).

M. Eiche pense que ces types de contrôleurs spécialisés seront les prochains à voir le jour. « Je ne pense pas que ce soit la mort des périphériques. Je pense qu’il s’agit plutôt d’une cure de jouvence. Si vous fabriquez un gant haptique, vous devriez être très enthousiaste ».

Apple pourrait se concentrer sur des interactions 3D plus avancées pour VisionOS 2.0 lors de la WWDC 24 en juin, plutôt que sur de nouveaux contrôleurs avancés. Mais cela ne veut pas dire qu’elles ne verront pas le jour un jour.

« Je pense qu’il faut souhaiter que nous allions aussi loin que possible sans le Pencil », déclare Eiche à propos de l’univers pratique de la réalité mixte sur Vision Pro actuellement, et peut-être sur d’autres appareils également. « Le cas d’utilisation du Pencil sera alors si parfait et si raffiné.